Eines der ersten Modelle, welches ich mit meinem frisch erworbenen 3D Drucker gedruckt habe, war der sogenannte Rocktopus. Eigentlich ein Oktopus mit dem Kopf von Dwayne The Rock Johnson. Damit habe ich einen Arbeitskollegen von mir überrascht.

Er hat kurz darauf einen 3D Drucker geschenkt bekommen und hat mich dann ebenfalls mit einem Modell von Dwayne The Rock Johnson überrascht, einer Ente mit seinem Kopf. Und so hat das Ganze ein wenig Fahrt aufgenommen, und in der Firma sind nun ganz viele Dwayne The Rock Johnson 3D Modelle zu finden, wie zum Beispiel der fROCK, die ROCKet, Dwayne The Glock Johnson und so weiter (ja, hier gibt es eine ganz eigene Welt, in die man hervorragend ins Rabbithole eintauchen kann).

Irgendwann war unser, oder vor allem mein, Dwayne The Rock Johnson Fetisch nicht mehr ganz so skalierbar. Die 3D Modelle sind ausgegangen und das Material wurde auch immer knapper. So musste ich mir etwas Neues überlegen.

App in Tauri

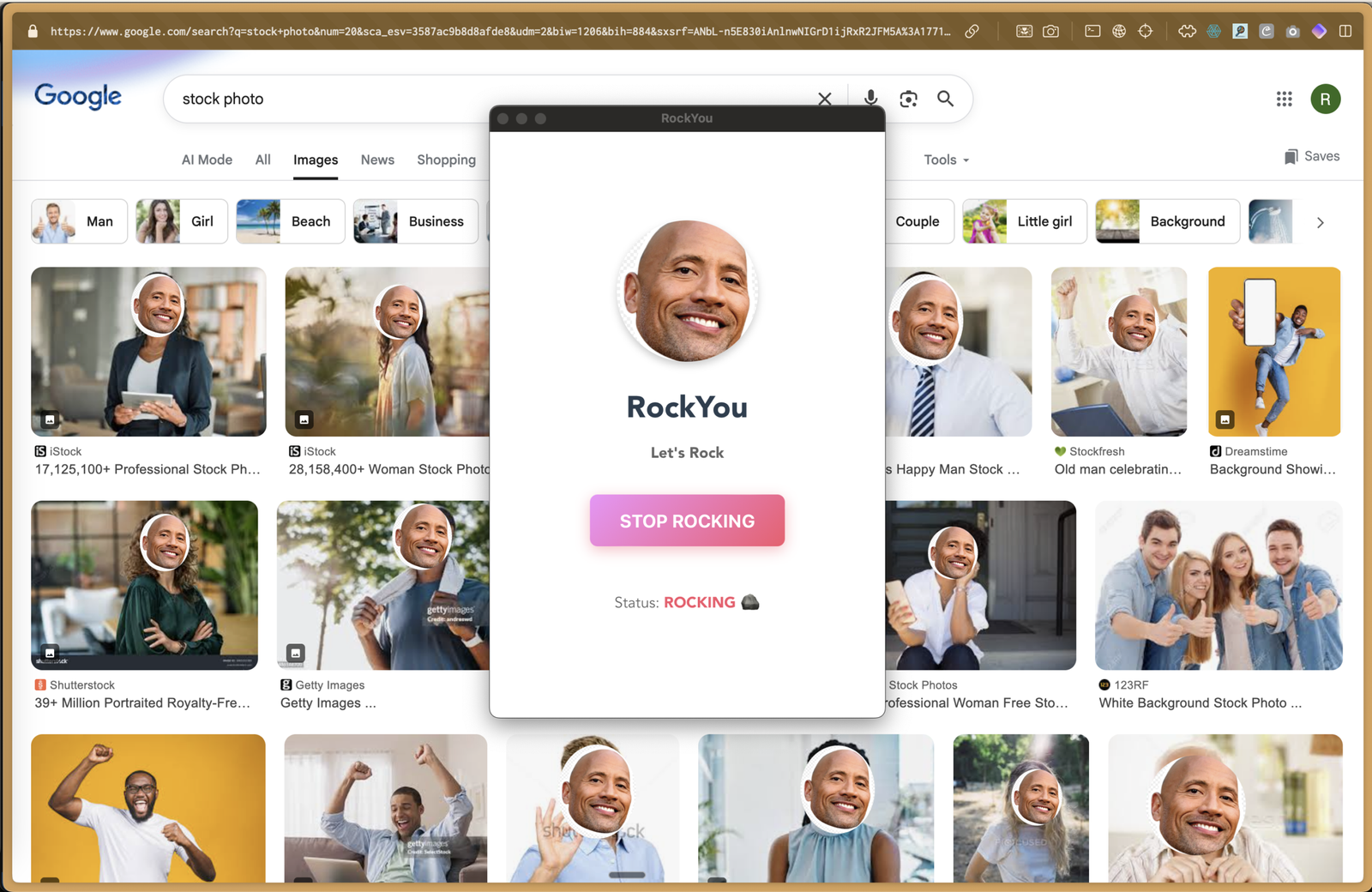

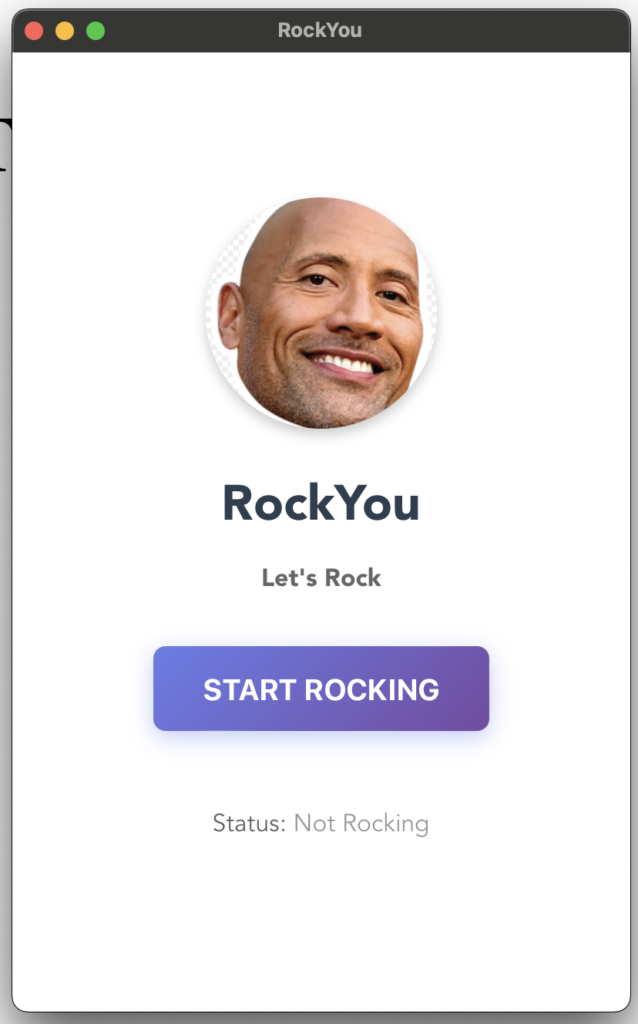

Da ich sowieso schon lange mal Tauri ausprobieren und überprüfen ob der Hype um den Ralph Wiggum Loop gerechtfertigt ist, kam mir eine hervorragende Idee. Ich habe mich entschieden, diese beiden Dinge zusammenzubringen und eine App zu bauen, die den aktuellen Screen recorded, eine Gesichtserkennung darüberlegt und so alle erkannten Gesichter mit demjenigen von Dwayne The Rock Johnson ersetzt.

Da es sich, wie bei mir üblich, um eine App handelt, die nicht ganz so ernst gemeint ist, wollte ich auch nicht unendlich viele Claude Code Credits damit in den Sand setzen, vor allem auch deshalb, dass ich noch keine Erfahrung mit Ralph Wiggum hatte und nicht wusste, wie viele Credits dieser Prozess benötigt, wie gut er überhaupt funktioniert und ob ich vielleicht auch einen Fehler mache und dann viel mehr Credits verbrauche als ich müsste.

Also habe ich mir kurzerhand das aktuellste Qwen-Coder Modell über ollama gezogen und den Rolf Wiggum Loop mit Ralphy und Open Code aufgesetzt und ihn dann so laufen lassen für eine erste Testversion oder einen ersten Prototypen dieser Stand. Nach circa einer halben Stunde war Ralphy fertig. Ich konnte die App jedoch aufgrund einiger Fehlkonfigurationen nicht starten. und das Screen Recording hat noch einige zusätzliche Berechtigungen (Security) benötigt. Ich musste noch einiges herumkonfigurieren, überarbeiten und dann zusammen mit Copilot das ganze final zum Laufen bringen.

Als es dann lief, waren die Gesichter von Dwayne the Rock Johnson so ziemlich überall auf dem Screen und haben die ganze Zeit die Position verändert. Es war wild, definitiv, aber leider nicht was ich erreichen wollte.

So habe ich das Gesichtserkennungsmodell ausgetauscht und die Thresholds angepasst, herumgetweakt, das ganze normalisiert, die Positionen besser detectet, nur Gesichter auf einer gewissen Grösse zugelassen, um erkannt zu werden, etc. Die typischen Einstellungen, um die Erkennung besser zu machen oder False Positives zu vermeiden. Danach hat sich aber die Gesichtserkennung zu häufig angepasst, beziehungsweise sie hat mehrmarls pro Sekunde ein Update gemacht, auch wenn nichts Neues dazugekommen ist oder der User nicht interagiert hat.

Das habe ich dann so angepasst, dass solange die Gesichter an der alten Position sind, bzw. keine Änderung der Position stattgefunden hat oder die Gesichter dieselben sind, dann wird kein Update gemacht. Die Gesichter bleiben dort, wo sie sind. Nur bei einer Veränderung gibt es ein Update

Fazit

Wie man jetzt auch hier auf dem nachfolgenden Beispielbild sieht, erkennt es nicht alle Gesichter, und es ist eine App, die definitiv noch ausbaufähig ist, auch in der Erkennung und in der Update-Geschwindigkeit. Aber für ein schnelles Projekt wollte ich nun nicht noch tiefer ins Rabbit Hole reingehen. Ich habe mal den Aufbau einer Tauri App gesehen und den Ralph Loop ausprobieren können. Beides super Technologien, die ich sicher wiedermal einsetzen werde.

Entsprechend hätte ich gesagt: Ziel erreicht. Die beiden Dinge, die ich anschauen wollte, habe ich angeschaut, und habe nun ein bisschen ein besseres Verständnis dafür.